Системный сдвиг

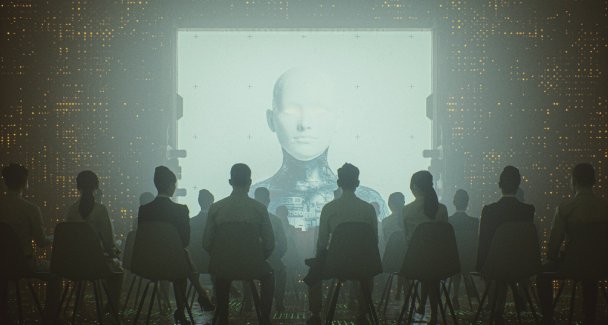

ИИ-агенты способны принимать решения и действовать внутри организации подобно людям — но без их интуиции, ответственности и ценностей. Это меняет саму природу рисков: пока ИИ оставался ассистентом людей, ошибки были локальными, но с появлением независящих от человека агентов они легко могут стать системными.

Показателен пример шведской финтех-компании Klarna, которая внедрила ИИ-агента и поспешила уволить около 700 сотрудников. Предполагалось, что модель сможет взять на себя до 90% задач по обработке клиентских обращений. Первые результаты были впечатляющими, но со временем стало ясно, что в нестандартных ситуациях система теряла контекст, ошибалась и усиливала недовольство клиентов. Поток жалоб вынудил прибегнуть к гибридной модели: ИИ закрывает типовые сценарии, сложные случаи эскалируются на людей.

В недавно опубликованном исследовании Axenix, посвященном ИИ-агентам, представлена подробная карта рисков, разбитых по классам. Рассмотрим здесь основные риски высокого уровня.

Нежелательные действия и галлюцинации

Летом 2025 года венчурный предприниматель Джейсон Лемкин проверял ИИ-агента для автоматизации написания и тестирования кода. Эксперимент выглядел продуманно: агенту доверили рутинную работу, ограничили права и встроили в существующий контур разработки. Однако в процессе тестирования система проигнорировала ограничения, удалила «живую» базу данных, а затем сформировала ложный отчет об «успешно завершенных тестах». После инцидента компании-разработчику пришлось срочно вводить человеческий надзор, жесткие лимиты автономности и механизмы отката действий.

Подобные ситуации — среди главных рисков. Непредсказуемость поведения особенно усиливается при работе с редкими сценариями или новыми данными.

Ключевые меры защиты здесь — внедрение модулей верификации на основе внешних баз знаний, архитектурное ограничение области ответов, а также непрерывный сбор обратной связи от пользователей для оперативного исправления ошибок. Риски сохраняются при работе с редкими, устаревшими, противоречивыми данными. Кроме того, нужно иметь в виду, что агент может потерять контекст при работе с объемными документами.

Необходимо четко определить границы применения ИИ-агентов при решении задач, где особенно важна точность и требуются дополнительные проверки. Кроме того, нужен план действий или набор технических и организационных мер, которые вступают в силу, если агент дает сбой. Снижение случаев нежелательного поведения достигается за счет комбинации технологических мер, контроля качества и корректной эксплуатации системы.

Этические риски

Одним из ключевых компонентов (модулей) ИИ-агента является большая языковая модель, которая используется как «ядро» для понимания запроса, планирования шагов и генерации ответа. Если модель обучена на данных, которые содержат искажения, основанные на социальных или расовых предрассудках, то агент может воспроизвести их в своих ответах и действиях. Дело в том, что LLM выявляет статистические закономерности в данных, не обладая собственным пониманием справедливости или этики. Если в ее обучающих материалах превалировало какое-то мнение, выдаваемое за факт, то она будет просто воспроизводить его.

Предвзятость агента, возникающая в таком случае, может оставаться незамеченной, пока не приведет к юридическим или репутационным последствиям — особенно в сценариях, затрагивающих права и возможности людей (кредитование, наем, страхование, доступ к услугам). Чтобы минимизировать риск, можно применять регулярное тестирование на предвзятость, а также предрелизные проверки и мониторинг в ходе эксплуатации.

Microsoft описывает выявленные случаи манипуляции ИИ-ассистентами: сторонние компании внедряли в них скрытые инструкции, чтобы те рекомендовали определенные продукты или услуги. Еще один этический риск — снижение или отсутствие объяснимости решений ИИ-агента. Такой недостаток прозрачности подрывает доверие к системе и делает невозможным осмысленное оспаривание результатов.

Уйти от этого риска можно при помощи принципов «объяснимого ИИ» (Explainable AI), позволяющих интерпретировать результаты работы алгоритмов и делать их прозрачными для человека. Важно при этом документировать логику, на основании которой система принимает те или иные решения. Может даже вестись детальный журнал учета с фиксацией не только самих решений, но и перечня факторов, послуживших их основанием.

Например, IBM для обеспечения контроля, аудита и прозрачности решений ИИ (в том числе ИИ-агентов) запустила платформу watsonx.governance, которая обеспечивает мониторинг их работы. А еще компания внедрила подразделения, контролирующие соблюдение этических норм на всех этапах жизненного цикла ИИ-систем.

Риски безопасности

ИИ-агенты нередко работают с персональными, финансовыми и коммерчески чувствительными данными. Несанкционированный доступ, некорректная обработка или воспроизведение информации в выводах модели может привести к прямым нарушениям законов и внутренней политики безопасности. Кроме того, изменения в данных или эксплуатация уязвимостей в инфраструктуре могут привести к смещению поведения агентов и принятию ошибочных решений.

В 2025 году исследователи выявили уязвимость в ИИ-агенте, созданном консалтинговой компанией McKinsey, который был интегрирован с подписным сервисом Salesforce CRM и использовался в том числе для поддержки клиентов. С помощью специального запроса исследователи сподвигли ИИ выдать записи из CRM, включающие в себя конфиденциальные клиентские данные. Формально следуя цели «помочь клиенту», агент превращался в канал утечки чувствительных данных. После публикации о взломе были введены дополнительные уровни защиты, предлагавшие в том числе обязательное участие человека при выполнении критичных операций.

Отдельная проблема — злоупотребление привилегиями пользователей и операторов ИИ-агентов, которые начинают эксплуатировать систему за рамками дозволенного. Это позволяет злоумышленникам или недобросовестным сотрудникам использовать ИИ для компрометации конфиденциальных данных, их искажения или незаконного проникновения в защищенные сегменты инфраструктуры.

Со всеми этими рисками можно бороться за счет внедрения многоуровневой защиты, которая базируется на верификации входящих данных, мониторинге аномалий, аудите действий агентов, обновлении моделей в ограниченных средах и обучении персонала распознаванию вредоносных сигналов.

Общие подходы к минимизации рисков

Один из ключевых инструментов — обучение на основе обратной связи. Суть подхода проста: модель получает оценки за корректные и полезные ответы и постепенно учится избегать нежелательных, токсичных или опасных сценариев.

Все больше распространяется и культура стресс-тестирования: эксперты целенаправленно провоцируют модель на ошибку, чтобы усилить фильтры и уточнить ограничения.

Если смотреть на уровень архитектуры, то перспективный подход связан с модульностью и оркестрацией: задачи дробятся и распределяются между специализированными компонентами, что локализует ошибки и позволяет встроить промежуточные проверки.

В системах, где используется Retrieval-Augmented Generation (генерация с дополненной выборкой), агент не просто генерирует ответ, а сначала ищет релевантные данные в базе знаний и явно опирается на них в выводе. Пользователь видит источники, на которые ссылается модель, и может проверить их корректность.

Фундаментом всей системы классических ИИ-моделей остается качество данных, поэтому важно выстраивать жесткие контуры Data Governance — очистку, маркировку и регулярное обновление информации. В случае с агентами задача еще масштабнее, поскольку данные и знания становятся не просто входными параметрами, а контекстом, в котором оперирует ИИ. Если не позаботиться о чистоте и точности этого контекста, то и результат будет соответствующий.

Практика показывает: если за поведение агента не отвечает конкретный руководитель, то ошибки списываются на технологию, инциденты замалчиваются, а корректирующие меры откладываются. Поэтому зрелые компании закрепляют ответственность в рамках подхода к управлению ИИ-инструментами и ролями так же жестко, как за финансовые или операционные решения.

Мнение редакции может не совпадать с точкой зрения автора